ConstantLR#

- class torch.optim.lr_scheduler.ConstantLR(optimizer, factor=0.3333333333333333, total_iters=5, last_epoch=-1)[source]#

將每個引數組的學習率乘以一個小的常數因子。

乘法操作會一直進行,直到 epoch 數量達到預先定義的里程碑:total_iters。請注意,這種乘以小常數因子的操作可以與來自此排程器外部對學習率的其他更改同時發生。當 last_epoch=-1 時,將初始學習率設定為 lr。

- 引數

示例

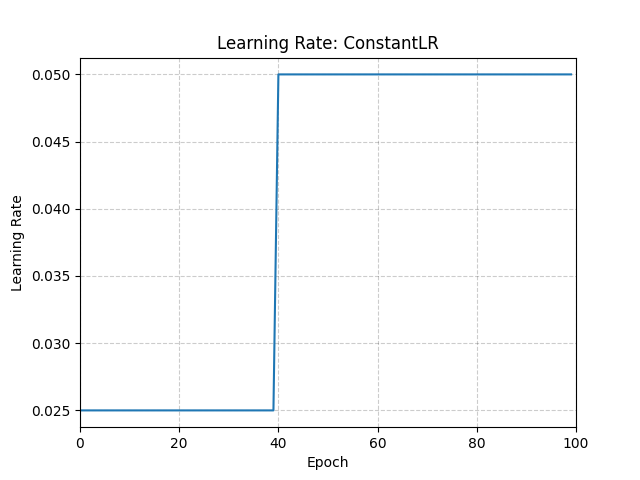

>>> # Assuming optimizer uses lr = 0.05 for all groups >>> # lr = 0.025 if epoch == 0 >>> # lr = 0.025 if epoch == 1 >>> # lr = 0.025 if epoch == 2 >>> # lr = 0.025 if epoch == 3 >>> # ... >>> # lr = 0.05 if epoch >= 40 >>> scheduler = ConstantLR(optimizer, factor=0.5, total_iters=40) >>> for epoch in range(100): >>> train(...) >>> validate(...) >>> scheduler.step()

- load_state_dict(state_dict)[source]#

載入排程器的狀態。

- 引數

state_dict (dict) – 排程器狀態。應為呼叫

state_dict()返回的物件。