注意

前往 末尾 下載完整的示例程式碼。

瞭解基礎知識 || 快速入門 || 張量 || 資料集 & DataLoaders || 變換 || 構建模型 || 自動求導 || 最佳化 || 儲存 & 載入模型

資料集 & DataLoaders#

建立時間:2021 年 02 月 09 日 | 最後更新:2025 年 09 月 24 日 | 最後驗證:2024 年 11 月 05 日

用於處理資料樣本的程式碼可能會變得混亂且難以維護;為了提高可讀性和模組化,我們理想情況下希望將資料集程式碼與模型訓練程式碼解耦。PyTorch 提供了兩個資料原語:torch.utils.data.DataLoader 和 torch.utils.data.Dataset,允許您使用預載入的資料集以及您自己的資料。Dataset 儲存樣本及其對應的標籤,而 DataLoader 將 Dataset 包裝成一個可迭代物件,以便輕鬆訪問樣本。

PyTorch 領域庫提供了許多預載入的資料集(例如 FashionMNIST),它們繼承自 torch.utils.data.Dataset 並實現了特定於該資料的功能。它們可用於原型設計和模型基準測試。您可以在此處找到它們:影像資料集、文字資料集 和 音訊資料集

載入資料集#

以下是如何從 TorchVision 載入 Fashion-MNIST 資料集的示例。Fashion-MNIST 是 Zalando 的文章影像資料集,包含 60,000 個訓練樣本和 10,000 個測試樣本。每個樣本包含一個 28×28 的灰度影像和一個來自 10 個類別之一的關聯標籤。

- 我們使用以下引數載入 FashionMNIST 資料集

root是儲存訓練/測試資料的路徑,train指定訓練或測試資料集,download=True會在root路徑下下載資料(如果資料不可用)。transform和target_transform指定特徵和標籤的轉換

import torch

from torch.utils.data import Dataset

from torchvision import datasets

from torchvision.transforms import ToTensor

import matplotlib.pyplot as plt

training_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor()

)

test_data = datasets.FashionMNIST(

root="data",

train=False,

download=True,

transform=ToTensor()

)

0%| | 0.00/26.4M [00:00<?, ?B/s]

0%| | 65.5k/26.4M [00:00<01:12, 364kB/s]

1%| | 229k/26.4M [00:00<00:38, 682kB/s]

3%|▎ | 885k/26.4M [00:00<00:12, 2.02MB/s]

14%|█▎ | 3.60M/26.4M [00:00<00:03, 7.15MB/s]

36%|███▋ | 9.60M/26.4M [00:00<00:01, 16.5MB/s]

47%|████▋ | 12.4M/26.4M [00:01<00:00, 16.1MB/s]

68%|██████▊ | 17.9M/26.4M [00:01<00:00, 22.2MB/s]

80%|███████▉ | 21.0M/26.4M [00:01<00:00, 22.8MB/s]

100%|██████████| 26.4M/26.4M [00:01<00:00, 18.1MB/s]

0%| | 0.00/29.5k [00:00<?, ?B/s]

100%|██████████| 29.5k/29.5k [00:00<00:00, 326kB/s]

0%| | 0.00/4.42M [00:00<?, ?B/s]

1%|▏ | 65.5k/4.42M [00:00<00:12, 360kB/s]

5%|▌ | 229k/4.42M [00:00<00:06, 677kB/s]

20%|██ | 885k/4.42M [00:00<00:01, 2.01MB/s]

81%|████████ | 3.57M/4.42M [00:00<00:00, 7.04MB/s]

100%|██████████| 4.42M/4.42M [00:00<00:00, 6.06MB/s]

0%| | 0.00/5.15k [00:00<?, ?B/s]

100%|██████████| 5.15k/5.15k [00:00<00:00, 45.2MB/s]

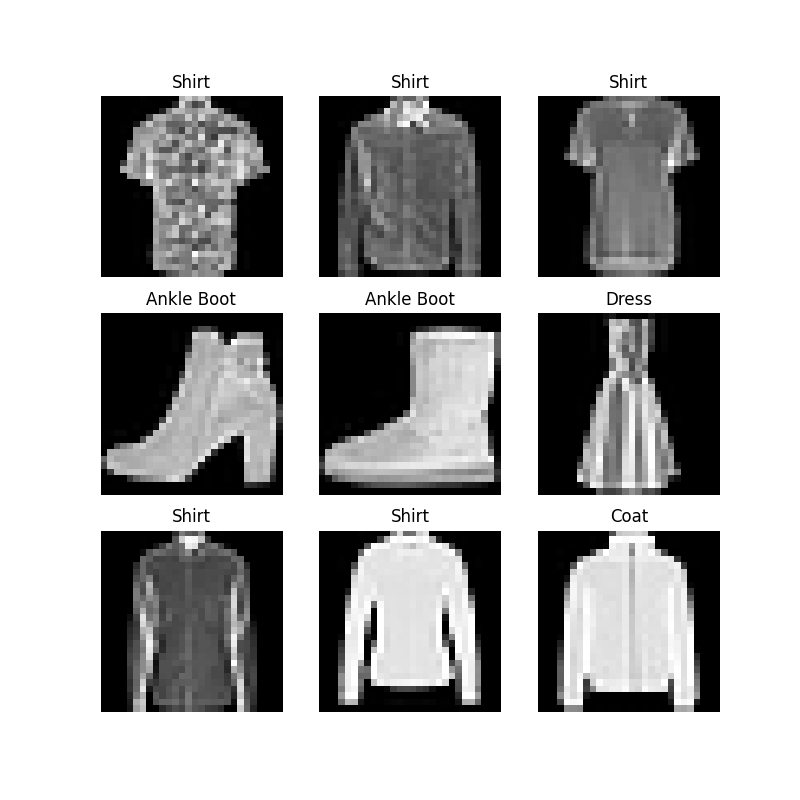

迭代和視覺化資料集#

我們可以手動索引 Datasets,就像列表一樣:training_data[index]。我們使用 matplotlib 來視覺化我們訓練資料中的一些樣本。

labels_map = {

0: "T-Shirt",

1: "Trouser",

2: "Pullover",

3: "Dress",

4: "Coat",

5: "Sandal",

6: "Shirt",

7: "Sneaker",

8: "Bag",

9: "Ankle Boot",

}

figure = plt.figure(figsize=(8, 8))

cols, rows = 3, 3

for i in range(1, cols * rows + 1):

sample_idx = torch.randint(len(training_data), size=(1,)).item()

img, label = training_data[sample_idx]

figure.add_subplot(rows, cols, i)

plt.title(labels_map[label])

plt.axis("off")

plt.imshow(img.squeeze(), cmap="gray")

plt.show()

為檔案建立自定義資料集#

自定義 Dataset 類必須實現三個函式:__init__、__len__ 和 __getitem__。請看這個實現;FashionMNIST 影像儲存在目錄 img_dir 中,它們的標籤分別儲存在 CSV 檔案 annotations_file 中。

在接下來的部分,我們將詳細介紹每個函式的作用。

import os

import pandas as pd

from torchvision.io import decode_image

class CustomImageDataset(Dataset):

def __init__(self, annotations_file, img_dir, transform=None, target_transform=None):

self.img_labels = pd.read_csv(annotations_file)

self.img_dir = img_dir

self.transform = transform

self.target_transform = target_transform

def __len__(self):

return len(self.img_labels)

def __getitem__(self, idx):

img_path = os.path.join(self.img_dir, self.img_labels.iloc[idx, 0])

image = decode_image(img_path)

label = self.img_labels.iloc[idx, 1]

if self.transform:

image = self.transform(image)

if self.target_transform:

label = self.target_transform(label)

return image, label

__init__#

__init__ 函式在例項化 Dataset 物件時被呼叫一次。我們初始化包含影像的目錄、註釋檔案以及所有變換(將在下一節中更詳細地介紹)。

labels.csv 檔案看起來像

tshirt1.jpg, 0

tshirt2.jpg, 0

......

ankleboot999.jpg, 9

def __init__(self, annotations_file, img_dir, transform=None, target_transform=None):

self.img_labels = pd.read_csv(annotations_file)

self.img_dir = img_dir

self.transform = transform

self.target_transform = target_transform

__len__#

__len__ 函式返回我們資料集中樣本的數量。

示例

def __len__(self):

return len(self.img_labels)

__getitem__#

__getitem__ 函式在給定的索引 idx 處載入並返回資料集中的一個樣本。根據索引,它識別影像在磁碟上的位置,使用 decode_image 將其轉換為張量,從 self.img_labels 中的 csv 資料中檢索相應的標籤,對它們呼叫變換函式(如果適用),然後返回張量影像和相應的標籤組成的元組。

def __getitem__(self, idx):

img_path = os.path.join(self.img_dir, self.img_labels.iloc[idx, 0])

image = decode_image(img_path)

label = self.img_labels.iloc[idx, 1]

if self.transform:

image = self.transform(image)

if self.target_transform:

label = self.target_transform(label)

return image, label

使用 DataLoaders 準備資料進行訓練#

Dataset 一次檢索一個數據集的特徵和標籤。在訓練模型時,我們通常希望以“小批次”的方式傳遞樣本,在每個 epoch 中重新洗牌資料以減少模型過擬合,並使用 Python 的 multiprocessing 來加快資料檢索速度。

DataLoader 是一個可迭代物件,它透過簡單的 API 為我們抽象了這些複雜性。

from torch.utils.data import DataLoader

train_dataloader = DataLoader(training_data, batch_size=64, shuffle=True)

test_dataloader = DataLoader(test_data, batch_size=64, shuffle=True)

迭代 DataLoader#

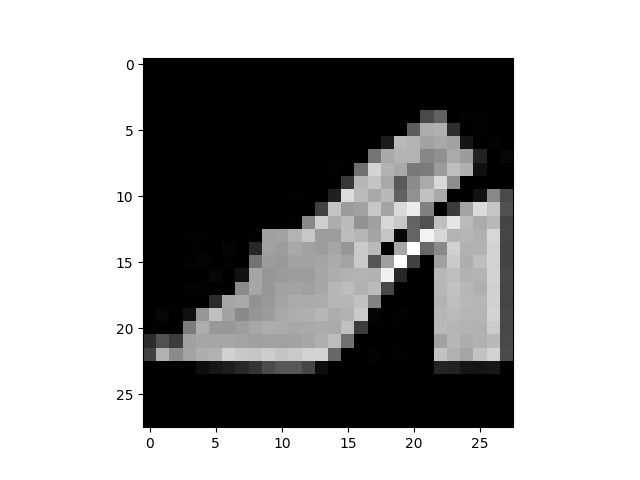

我們將資料集載入到 DataLoader 中,並可以根據需要迭代資料集。下面的每次迭代返回一個包含 batch_size=64 個特徵和標籤的 train_features 和 train_labels 的批次。因為我們指定了 shuffle=True,所以在我們迭代完所有批次後,資料會被打亂(有關資料載入順序的更精細控制,請參閱 Samplers)。

# Display image and label.

train_features, train_labels = next(iter(train_dataloader))

print(f"Feature batch shape: {train_features.size()}")

print(f"Labels batch shape: {train_labels.size()}")

img = train_features[0].squeeze()

label = train_labels[0]

plt.imshow(img, cmap="gray")

plt.show()

print(f"Label: {label}")

Feature batch shape: torch.Size([64, 1, 28, 28])

Labels batch shape: torch.Size([64])

Label: 5

進一步閱讀#

指令碼總執行時間: (0 分鐘 5.074 秒)